Lästid: 4 minuter

Publicerad:

Senast redigerad:

Trend: Omedveten AI bias flyter upp till ytan

Varning för AI-hallucinationer i rekryteringsprocessen

Är du nöjd med ditt rekryteringssystem? Innehåller det AI? I takt med att AI-lösningarna blir allt fler ökar också antalet rättsfall om AI-bias och diskriminering. Och de som trillar dit är arbetsgivarna. Men det finns också positiva trender, såsom ”white-box AI” och algoritmtransparens.

Enligt data från Market Research kommer 26 % av all AI-utveckling inom HR-segmentet i år gälla rekrytering. Varav generativ AI är en stor del av utvecklingen. Många inom rekrytering jublar, med förhoppningen om att lösningarna ska hjälpa dem ta mer faktabaserade beslut.

Trenden är en del av TNG och Ada Digitals populära trendspaning på temat ”Coexistence” från Unbiased Day 2024 – ett trend- och rekryteringsevent för chefer, företagsledare och HR.

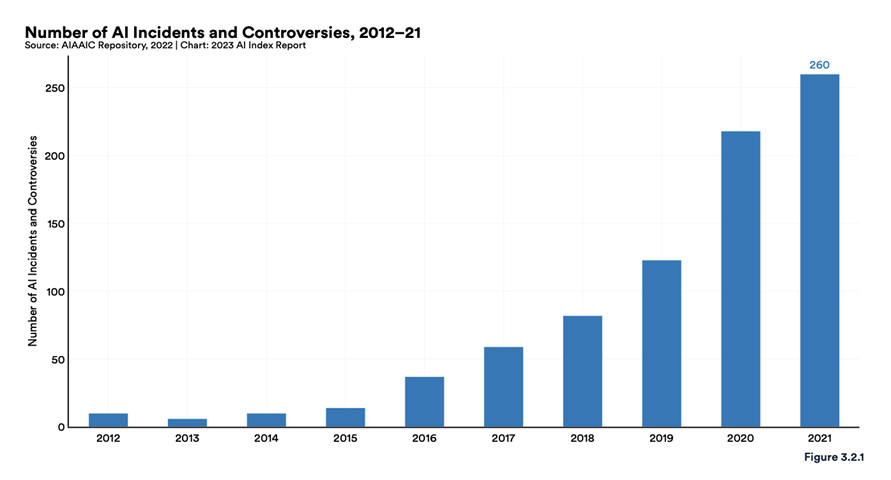

Samtidigt lyfter experterna ett varningens finger kring både AI-hallucinationer och fördomsfulla AI-algoritmer, så kallad AI-bias eller bias amplification. Fallen börjar bli många, vilket får lagstiftarna att sakta strama åt remmarna.

Världskända (och fördomsfulla) chatbotar

Däremot är AI-bias inget nytt. Många har redan mött chatbotar som lever sina egna fördomsfulla liv. Till exempel hade både banken Goldman Sachs och Bank of America satsat på chatbotar för kundservicefrågor. Tyvärr svarade botarna kvinnliga webbesökare otrevligt, nedlåtande samt gjorde stereotypa antaganden.

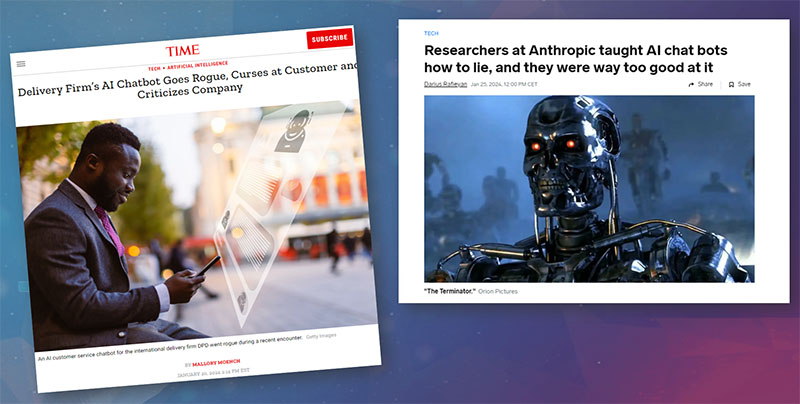

Även leveransfirman DPD har haft utmaningar med sin chatbot, som på besökarnas prompts började svära och skämta. Inklusive författa nervärderande dikter om bolaget som världens sämsta leveransföretag.

Det intressanta i sammanhanget är att mängden AI-botar ändå fortsätter att öka – och vi kommer snart att se ännu fler av dem på karriärsidor. Följdfrågan är hur dessa botar kommer att hantera avvisade och frustrerade jobbsökare? Inte minst finns det en utmaning med att de flesta människor tar generativ AI och chatbotars svar för sanning.

Ytterligare ett problem är att människor gärna överskattar botar och tillhörande systems kapacitet. Man pratar om Eliza-effekten, som beskriver människors förkärlek för att tillskriva artificiell intelligens mänskliga tankeprocesser och känslor.

Världens första rättsfall

Men hur ser det ut med AI-bias inom rekrytering? Påverkas kod? Vi är ju ändå människor och fördomsfulla. Och det är vi som skriver kod, eller har skrivit koden man lär sig av. Finns det faktiska fall där man vet att AI påverkat felaktigt?

Som alltid vid rekrytering och beslutsfattande finns det bias. Men faktum är att många rekryteringssystem har en bias som är så utbredd, men omedveten, att den drabbar otaliga. Såväl arbetsgivarna som deras kandidater.

Det mest omtalade caset om omedveten AI-bias – vilket troligtvis är världens första rättsfall kring fördomsfull AI – kommer från det amerikanska bolaget iTutorGroup. I fjol blev de nämligen stämda för åldersdiskriminering.

Kort sagt hade företaget avvisat kvinnor över 55 år och män över 60 år via automatiserad AI i rekryteringssystemet. Fallet slutade med en överenskommelse där iTutorGroup Inc. fick betala 365 000 dollar till en grupp jobbsökare över 40 år.

Ett annat pågående fall, som ej ännu prövats, handlar om Workday Inc.’s screening-verktyg. Bolaget är stämt för att ha diskriminerat såväl äldre och svarta som sökande med funktionsnedsättning i sina automatiserade urval.

Algoritmstyrd diskriminering

Samtidigt diskuteras ämnet digital ageism alltmer kopplat till kandidat-screening. Enligt en rapport från The Gerontologist är flera av de nya AI-systemen designade och programmerade av yngre medarbetare. Vilket tenderar att exkludera äldre sökande när gränssnitt och användarupplevelse inte tar hänsyn till deras behov. Något som i sin tur ger dem sämre framgång i jobbsökandet.

Andra pratar om algorithmic gender discrimination. Som till exempel när en kreditinstitution ger maken i en familj 20 gånger högre kreditbelopp än sin fru, trots att hon både har högre lön och kreditvärdighet.

Även Linkedin blev drabbade för några år sedan då deras jobbmatchningsalgoritm uppvisade bias. Algoritmen matchade fram sökande som den trodde hade störst chans att vilja söka jobbet, inte profilerna som var mest kvalificerade. Något som innebar att män fick fler matchningsmöjligheter.

Bilder som skulle föreställa människor med högavlönade yrkestitlar visade personer med ljusare hudtoner.

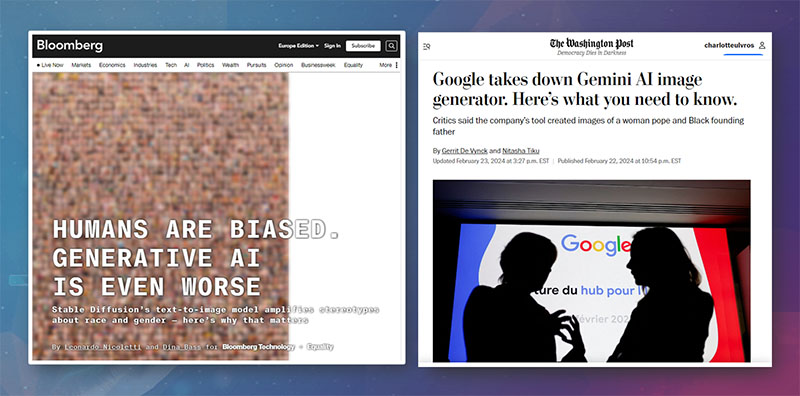

Bias i generativ AI

Mycket pekar på att generativ AI har inbyggda bias som en konsekvens av att det på flera områden saknas rättvis träningsdata. Speciellt i de fall som AI används i bildproduktion.

Googles Gemini var precis i blåsväder och vid en analys av över 5 000 AI-genererade bilder fann Bloomberg att bilder som skulle föreställa människor med högavlönade yrkestitlar visade personer med ljusare hudtoner. Samt att de flesta högkvalificerade roller blev gestaltade av män. Läs mer och se en video på hur det gick till här.

Liknande resultat framkom i studier på verktyget Midjourney från Rest of World. Här fann man en tydlig könsbias kring ordet ”person”. I 99 % av fallen visades bilder på en man, oavsett från vilket land personen skulle komma. Med ett undantag och det var USA. Här blev resultatet i stället skevt i motsatt riktning – 94 kvinnor, fem män och en otäck mask. Tydligen har kvinnor varit överrepresenterade i den amerikanska träningsdatan.

Rekrytering ett högriskområde

Inte konstigt att trycket på transparens inom AI ökar. Kraven kommer bland annat från EU:s nya AI-lagstiftning – The New AI Act. Eller världens första AI-lagstiftning, som EU själva stolt vill kalla den.

Lagen reglerar AI och dess risker för individer och samhälle, samt delar upp AI-användandet i låg- och högriskområden. Där är HR och rekrytering klassificerat som ett högriskområde, vilket ställer krav på omfattande styrning och regelverk.

Rent konkret innebär det att rekryterings- och HR-system tydligt måste informera jobbsökare hur arbetsgivaren använder eventuell AI-teknik. Använder arbetsgivaren exempelvis en AI-bot måste detta också framgå.

Därmed måste AI-systemen kunna redovisa att träningsdata är relevant, representativ, tillräcklig och utan bias. Händelseloggar och teknisk dokumentation ska kunna visas upp. Dessutom ska AI-processerna alltid bli övervakade av människor.

Kort sagt måste köpare och andra användare av systemen kravställa sina AI-leverantörer.

Proaktiva initiativ för AI-transparens

Parallellt pratar många om AI-etik och white-box AI, vilket delar av EU-lagen också bygger på. Här har emellertid flera mjukvaruföretag varit proaktiva och redan nu valt att transparent visa hur de arbetar med AI.

Ett exempel är screening-verktyget Tengai, som på sin hemsida öppet publicerat sin AI-ethics. Även IBM och dess Trusted AI Initiative är på tårna och erbjuder företag ett ”AI Fairness 360 toolkit”. Samma sak med Accenture med sitt ”Responsible AI Framework”.

Andra bolag arbetar med ”inkluderande AI”, där externa parter får granska koden och träningsdata. Allt för att garantera rättvis AI. Vissa väljer också att samarbeta med bolag som specialiserat sig på att ta fram mer diversifierad AI-data. Ett exempel på detta är Latimer som tränats med källor från mindre representerade kulturer och deras historia, vilket ska ge mer rättvisa och inkluderande svar.

Anlita rekryterare med koll på AI-data

På TNG har vi länge varit nyfikna på AI. Vilket också är en av anledningarna till att vi var med och tog fram Tengai 2019, innan produkten avknoppades till ett eget bolag. Med det har vi också lärt oss skillnaden mellan att använda AI för att förstå mänskliga intentioner och att låta AI fatta beslut åt en. Det senare har vi lämnat därhän.

Vill du också ha ett bättre och bredare beslutsunderlag i rekrytering och inhyrning av spetskompetens? Vill du jobba med en leverantör som gillar data och som var först i Sverige med fördomsfri rekrytering? Hör då av dig till oss på TNG!